作者:finedatalink

发布时间:2024.4.25

阅读次数:270 次浏览

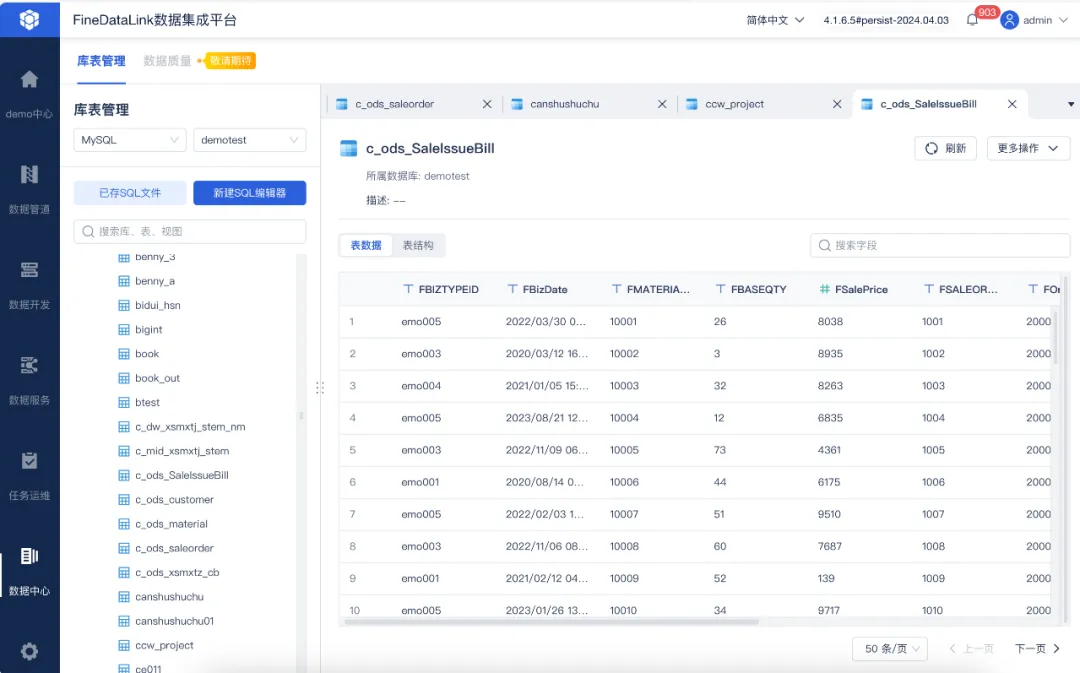

FineDataLink作为企业的数据集成中心,经常需要查看多类数据库上下游数据以及SQL查询,为了在一个平台更好地协同,从4.1.6版本起提供库表管理功能,方便直接查询数据库数据和SQL的编写调试。

同时也是即将上线的血缘功能的基础,方便在看到ETL任务全链路上下游的同时,追溯源表数据。

库表管理查询

💠详情:库表管理

MongoDB是一个基于分布式文件存储的数据库,属于NoSQL中的一种非关系型数据库,当业务系统的数据量大、读写操作频繁的时候会选择MongoDB数据库作为数据存储,例如运维监控系统、第三方信息抓取和存储、游戏业务、物联网业务场景等。从4.1.6版本起,FineDataLink可支持在定时ETL过程中,将数据写入MongoDB。

MongoDB写入

💠详情:MongoDB输出

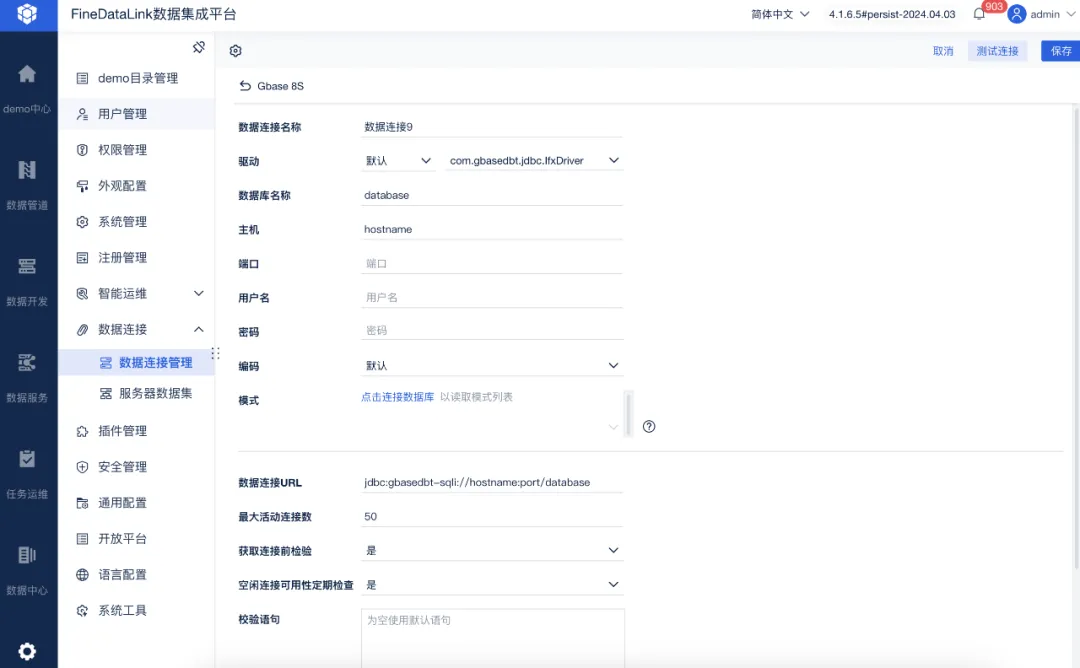

4.1.6版本中FineDataLink 支持连接 Gbase 8s 数据库,进行定时任务的读取。

配置Gbase 8s数据源

💠详情:配置Gbase 8s数据源

达梦数据源是大型通用关系型数据库,多数企业应用其进行存储管理和处理大量结构化数据。4.1.6版本开始管道任务支持写入达梦数据库,用户可以通过管道任务对接达梦数据库将数据实时写入,从而满足企业对更高时效性的需求。

💠详情:配置达梦数据源

在数据服务模块中,FineDataLink 支持将处理好的数据库中的数据通过 API 形式发布出去,供其他工具使用,在4.1.6版本中新增6种数据源:

| 版本 | 数据源 |

| 4.1.6 新增 | GBase8s |

| KingbaseES | |

| ClickHouse | |

| SAP Hana | |

| 达梦 | |

| HP Vertica | |

| 历史版本 | MySQL、SQL Server、Oracle、 PostgreSQL、 GreenPlum、 FineBI公共数据、IBM DB2、 Doris、 TiDB、 Impala、 StarRocks、 TRANSWARP INCEPTOR、 StarRocks、 GaussDB 200、 阿里云Maxcompute |

💠详情:支持的数据源范围

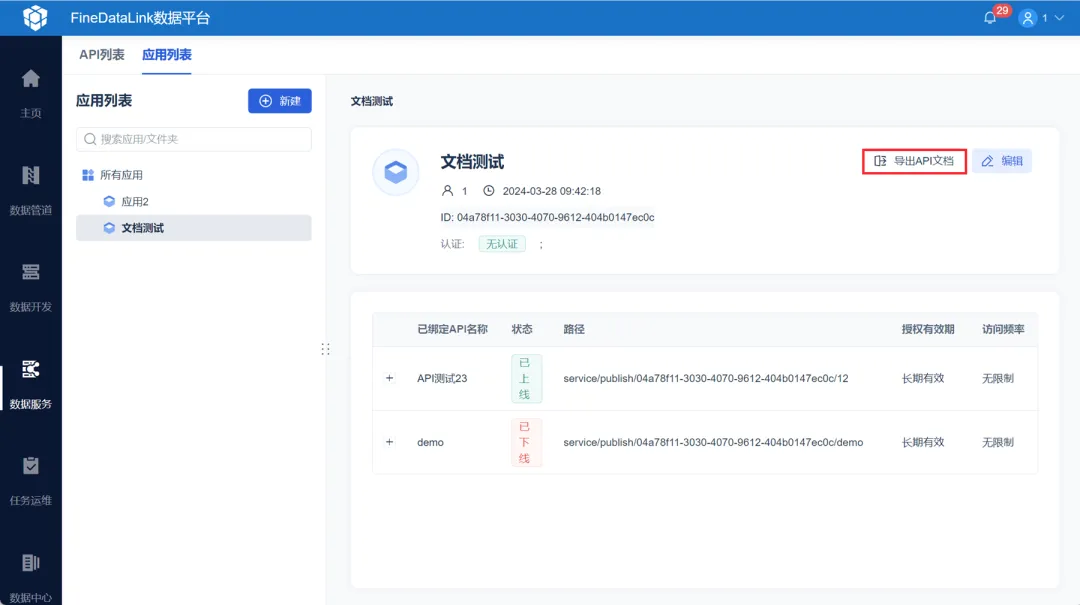

在FDL中,数据服务模块支持以API接口的方式提供数据,当API开发者完成开发后,将接口交由API使用者进行调用,这时候可以在应用管理界面,一键快速生成API接口文档,提供给API使用者查看,这个过程将接口标准化,提高了人员配合效率。

接口文档导出

💠详情:导出API接口文档

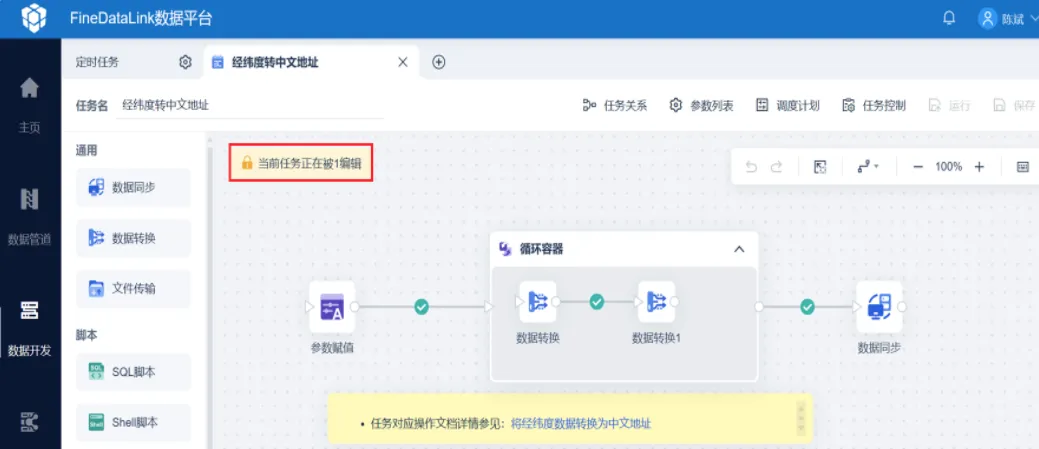

一个任务同时被多人编辑时,先保存的内容会被之后保存的内容覆盖,导致前者开发内容被误删。4.1.6版本中起禁止被多人同时编辑,方便任务的管理。当用户编辑某个任务时,其他用户也打开该任务,则会提示:当前任务/API/应用正在被XX编辑,其他人无法编辑该任务,只能查看。

任务禁止被多人同时编辑

💠详情:任务禁止被多人同时编辑

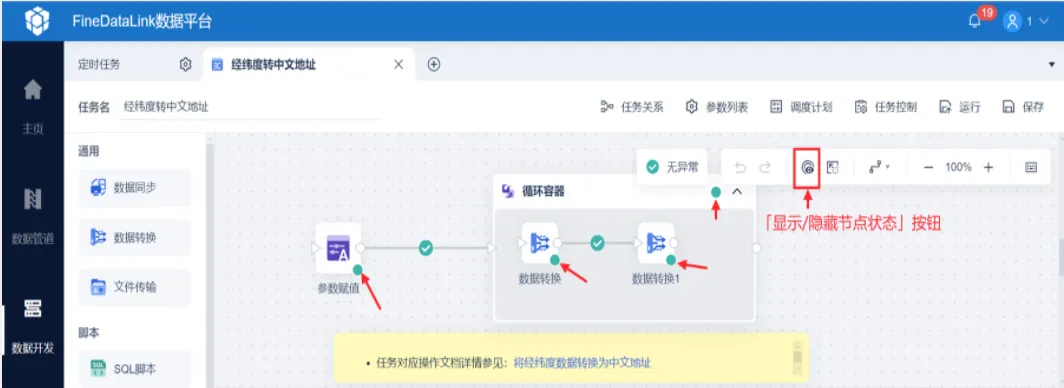

在FDL 4.1.6版本中,当定时任务运行后,可以在任务界面快速查看本次运行的节点情况,若出现问题,方便快速定位到出错节点。

运行图标含义

💠详情:数据开发界面介绍

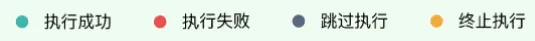

在FDL 4.1.6版本中,数据转换内的算子支持禁用,可通过「禁用节点及下游」,禁用该节点和该节点的下游节点。

常见场景:

1. 数据转换内部分算子暂不执行的情况,但后续可能会执行,不想彻底删除

2. 用户为了调试新增一些算子,不想将调试算子删除

数据转化算子禁用

💠详情:节点支持禁用

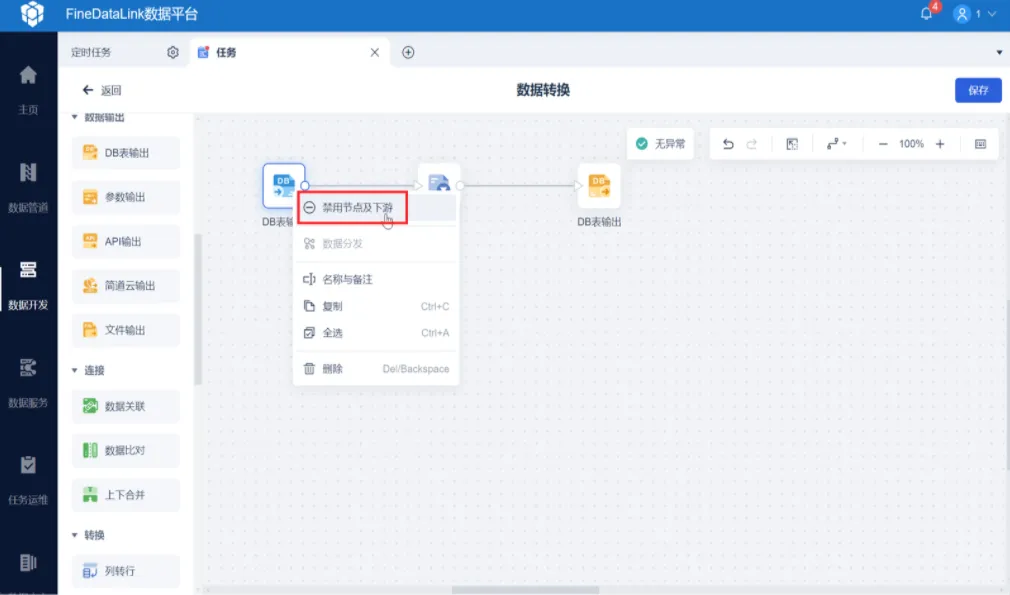

为了提升用户对JSON解析算子使用的体验,4.1.6版本中支持同时解析多个字段,且同时解析一个JSON源字段的数组部分和非数组部分,减少多个复杂JSON解析的成本。

JSON解析

💠详情:JSON解析算子功能说明

4.1.6版本可控制登录页底部是否显示备案信息,默认关闭。开启后,用户可输入备案信息,点击「保存」,则登录页底部显示备案信息。点击备案号,即可链接跳转至工业和信息化部政务服务平台。

登录页备案

💠详情:登录页- FineDataLink帮助文档 ICP/IP地址/域名信息备案管理系统

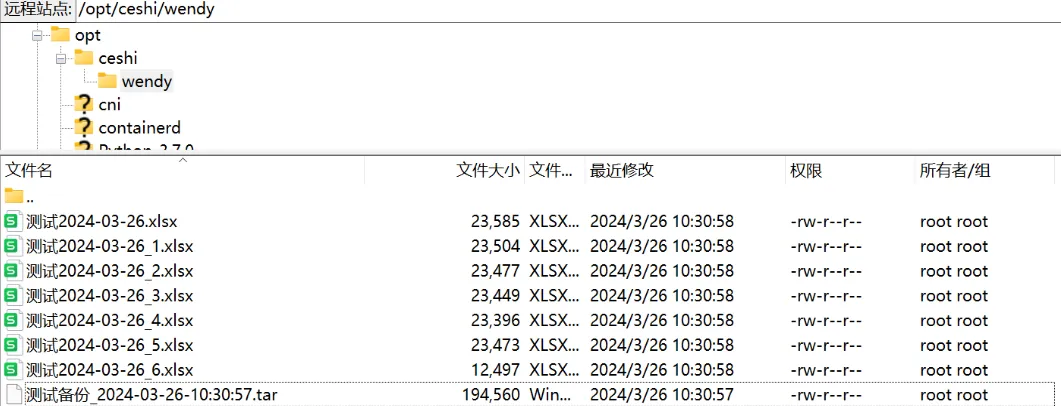

每次运行后,被拆分的文件存在重名情况,若运行了两次任务,第一次被拆分的文件依然存在,影响用户查看文件数据,或者被拆分的文件以日期和时间命名,文件不重名,但随着运行次数增多,生成的拆分文件过多,占用空间。为解决这一问题,文件拆分只保留最新拆分的文件。可以看到该文件夹下只保留最新生成的文件,上一次生成的文件会打包压缩备份起来。

💠详情示例:文件拆分:只保留最新拆分的文件

在数据同步时,为了保证数据时效性,有时我们需要对数据定时进行增量更新,比如每天将增量部分的数据(来源表)更新至目标数据表中。若目标表中「订单生成时间」的最大值,小于来源表的「订单生成时间」,说明来源表存在新增数据,需要将新增数据(增量)同步到目标表中。

💠示例:数据增量更新同步

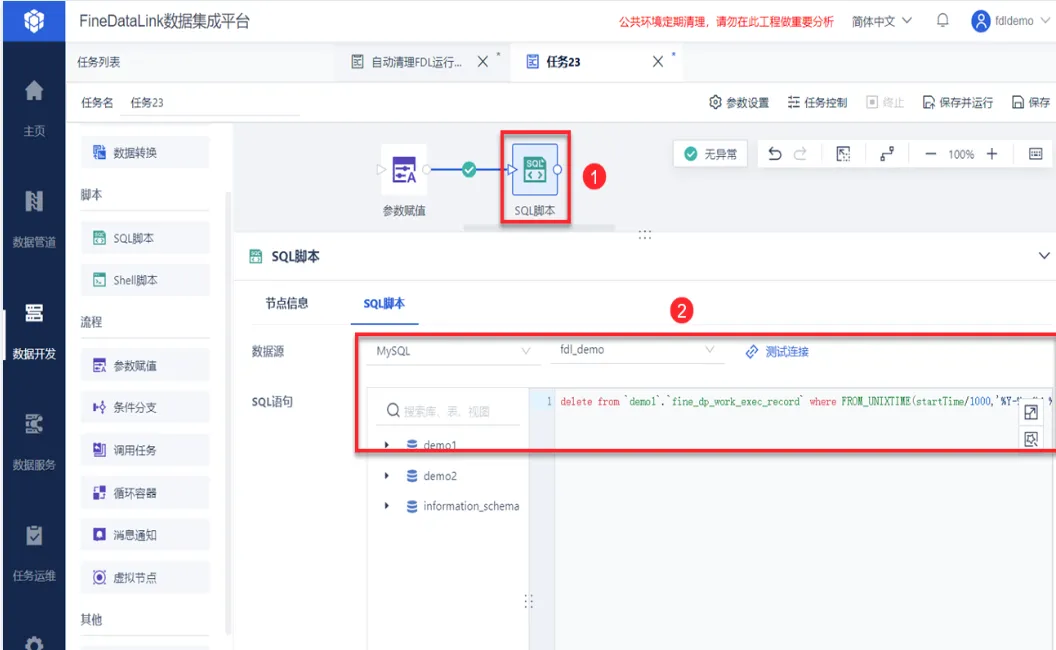

随着 FineDataLink 工程使用时间的增长,fine_dp_work_exec_record(记录定时任务的执行情况)表中的数据会不断积累,导致数据量逐渐增多。当数据量过大时,打开「任务运维>定时任务>运行记录」页面可能会变得缓慢,需要耗时 10 秒以上。为解决这一问题使用 FineDataLink 定期清理 30 天前的定时任务的运行记录数据。

💠详情参见:自动清理FineDataLink运行记录

💠产品更新详情:4.1.6更新日志

FineDataLink是一款集实时数据同步、ELT/ETL数据处理、数据服务和系统管理于一体的数据集成工具,可在Windows或Linux环境上单机/集群部署,全程基于B/S浏览器端进行任务开发和任务运维,更多精彩功能,邀您体验,希望能帮您解决企业中数据从任意终端到任意终端的处理和传输问题,让流动的数据更有价值。

数据集成平台产品更多介绍:www.finedatalink.com

上一篇: 「产品更新」通用型JDBC取数扩展,上下合并、汇总等可视化算子增强,指定日期和参数重试,数据服务新增7种数据源等下一篇: 台晶电子:数据管理创新,引领制造业进入自动化的快车道